Introducción

En el vertiginoso mundo del procesamiento de lenguaje natural, los modelos de Transformer han sido la piedra angular, impulsando avances en todo, desde traducción automática hasta asistentes virtuales inteligentes. Sin embargo, a pesar de su innegable éxito, estos modelos enfrentan un desafío formidable: procesar y comprender textos extremadamente largos. Aquí es donde entra en juego un innovador estudio, llevado a cabo por un equipo de investigadores de Google, que promete superar esta barrera con los «Infini-Transformers«.

En su revolucionario paper, «Leave No Context Behind: Efficient Infinite Context Transformers with Infini-attention«, Tsendsuren Munkhdalai, Manaal Faruqui y Siddharth Gopal presentan los Infini-Transformers. Esta nueva generación de modelos de lenguaje aborda de frente las limitaciones de sus predecesores, brindando la capacidad de manejar secuencias de texto de longitud prácticamente ilimitada. Este avance no es solo una mejora técnica; representa un cambio de paradigma en cómo las máquinas pueden procesar y entender el lenguaje humano.

¿Pero qué hace que los Infini-Transformers sean tan especiales y cómo logran esta proeza? En este post, exploraremos las intrincadas mecánicas de esta innovación y las puertas que abre para el futuro del procesamiento de lenguaje natural. Prepárate para sumergirte en un mundo donde las limitaciones de longitud en los textos son cosa del pasado y donde el potencial de la inteligencia artificial para comprender y sintetizar la información alcanza nuevas e impresionantes alturas.

El Desafío de los Textos Largos en IA

El procesamiento de lenguaje natural (PLN), una rama crucial de la inteligencia artificial, ha experimentado avances significativos en la última década. Sin embargo, una limitación persistente ha sido el manejo de textos largos. La mayoría de los modelos de PLN, incluidos los populares Transformers, se encuentran con dificultades al procesar secuencias de texto que superan un cierto límite de longitud. Este límite no es simplemente una restricción técnica; representa un obstáculo considerable para aplicaciones prácticas del mundo real.

¿Por qué es este un desafío tan crítico? Primero, consideremos el contexto. En muchas situaciones, como en la revisión de documentos legales, la investigación académica o incluso la lectura de literatura, es esencial entender y analizar grandes bloques de texto. Estos textos pueden contener argumentos complejos, narrativas intrincadas o datos detallados que se extienden a lo largo de cientos de páginas. Los modelos de PLN que solo pueden comprender fragmentos más pequeños de texto pierden el contexto general, las referencias cruzadas y la cohesión temática que solo se revelan en análisis más extensos.

En segundo lugar, está la cuestión de la continuidad y la coherencia. Los textos largos, como los libros o los informes de investigación, a menudo construyen ideas de manera secuencial. Un modelo que solo puede ‘ver’ partes pequeñas de texto a la vez podría perder la ‘imagen completa’, lo que lleva a interpretaciones fragmentadas o incoherentes.

Hasta ahora, los investigadores y desarrolladores han intentado superar estas limitaciones de varias maneras, pero cada una con sus propias compensaciones en términos de precisión, eficiencia de memoria y capacidad de cómputo. El resultado ha sido un equilibrio constante entre la amplitud de la comprensión y la profundidad del análisis.

Los Infini-Transformers, presentados por el equipo de Google, prometen cambiar este panorama, abordando estos desafíos de frente. Al permitir un procesamiento eficiente y una comprensión más profunda de secuencias de texto largas, estos modelos están preparados para llevar el PLN a nuevos horizontes de capacidad y utilidad. Pero, ¿cómo logran exactamente esta hazaña? En la siguiente sección, exploraremos las innovaciones detrás de los Infini-Transformers y cómo superan las limitaciones de sus predecesores.

Infini-Transformers al Rescate

Tras identificar la limitación fundamental de los modelos de PLN existentes en el manejo de textos extensos, el equipo de Google dio un paso adelante con una solución innovadora: los Infini-Transformers. Estos modelos no son solo una mejora incremental sobre los Transformers convencionales; son un rediseño radical que redefine las reglas del juego en el procesamiento de lenguaje natural.

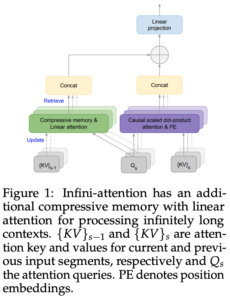

Los Infini-Transformers se destacan principalmente por su incorporación de Infini-attention, una técnica que fusiona lo mejor de dos mundos: la atención local enmascarada y los mecanismos de atención lineal a largo plazo. Mientras que la atención local se enfoca en segmentos específicos del texto, proporcionando detalles y precisión, la atención a largo plazo permite al modelo mantener un hilo coherente a través de extensas secuencias de texto, algo que anteriormente era un desafío considerable.

Pero la verdadera magia de los Infini-Transformers radica en su memoria compresiva. A diferencia de los sistemas de memoria convencionales que se expanden y se vuelven menos manejables con textos más largos, la memoria compresiva de los Infini-Transformers utiliza un conjunto fijo de parámetros. Esto permite que el modelo almacene y acceda a información relevante de una manera mucho más eficiente, superando los límites de memoria y los desafíos computacionales asociados con los modelos anteriores.

El impacto de estas innovaciones es profundo. Al integrar Infini-attention con memoria compresiva, los Infini-Transformers pueden procesar y comprender secuencias de texto de una longitud que era impensable para los modelos anteriores. Esta habilidad no solo mejora la eficiencia del procesamiento de texto, sino que también amplía significativamente el alcance y la utilidad de los sistemas de PLN. Desde analizar libros enteros hasta digerir documentos legales extensos, los Infini-Transformers están equipados para manejar tareas que antes estaban fuera del alcance de la tecnología de PLN.

Al superar las limitaciones de longitud y memoria, los Infini-Transformers no solo resuelven un problema técnico desafiante, sino que también abren un mundo de posibilidades para aplicaciones más complejas y sofisticadas en el campo del procesamiento de lenguaje natural.

Ventajas y Avances Clave

Los Infini-Transformers no solo representan una innovación técnica en el procesamiento de lenguaje natural; también marcan un hito en términos de eficiencia y rendimiento. A continuación, exploramos las ventajas y los avances clave que estos modelos han logrado, subrayando por qué son un avance tan significativo en el campo del PLN.

1. Mejora Sustancial en la Compresión de Memoria

- Los Infini-Transformers han demostrado una capacidad de compresión de memoria notablemente mejorada en comparación con sus predecesores. Con una proporción de compresión 114 veces mayor que los Memorizing Transformers, estos modelos ofrecen una eficiencia en el uso de la memoria sin precedentes. Este avance es fundamental, ya que permite que los Infini-Transformers manejen textos largos sin la penalización de un incremento exponencial en los requisitos de memoria.

2. Rendimiento Superior en Tareas de Lenguaje Natural

- En pruebas de benchmark como PG19, los Infini-Transformers no solo han manejado con éxito textos de gran longitud, sino que también han mostrado una mejora en la puntuación de perplejidad, una medida estándar para evaluar modelos de lenguaje. Esto indica una mayor capacidad para predecir y entender el lenguaje humano, incluso en contextos extensos y complicados.

3. Logros en Tareas Específicas con Largos Contextos

- Los Infini-Transformers han establecido nuevos estándares en tareas específicas que requieren el manejo de grandes cantidades de texto. Por ejemplo, en la tarea de recuperación de passkey, un modelo LLM de 1B con Infini-attention escaló exitosamente a secuencias de 1 millón de tokens. En la tarea de resumen de libros de 500K tokens de longitud, los modelos con Infini-attention superaron a otros enfoques, estableciendo un nuevo estado del arte.

Estos avances no solo resaltan la superioridad técnica de los Infini-Transformers, sino que también señalan su potencial para transformar la manera en que interactuamos y utilizamos la tecnología de PLN. Desde el análisis en profundidad de textos extensos hasta la generación de resúmenes detallados y precisos, los Infini-Transformers abren la puerta a una era donde las limitaciones de longitud de texto ya no son un obstáculo para la comprensión y el análisis de lenguaje.

Casos de Uso y Potencial Futuro

Los Infini-Transformers no solo son una hazaña de la ingeniería de inteligencia artificial, sino que también son una promesa de nuevas y emocionantes aplicaciones en el mundo real. Esta tecnología no solo aborda desafíos preexistentes, sino que también abre la puerta a innovaciones futuras en el procesamiento del lenguaje natural. Veamos algunos de los casos de uso y posibilidades futuras que estos modelos avanzados podrían traer.

1. Análisis en Profundidad de Documentos Extensos

- Con su capacidad para manejar grandes volúmenes de texto, los Infini-Transformers son ideales para analizar documentos extensos como contratos legales, investigaciones académicas y literatura. Pueden ayudar a identificar patrones, temas y relaciones en textos que anteriormente eran demasiado largos para ser analizados eficientemente por modelos de PLN.

2. Mejora en Asistentes Virtuales y Chatbots

- Los asistentes virtuales y chatbots podrían beneficiarse enormemente de los Infini-Transformers, ya que permiten una comprensión más profunda y un seguimiento más preciso de las conversaciones largas y complejas. Esto conduciría a interacciones más naturales y coherentes, mejorando significativamente la experiencia del usuario.

3. Innovaciones en Resúmenes Automáticos

- La capacidad de procesar textos largos también podría revolucionar el campo del resumen automático. Los Infini-Transformers podrían generar resúmenes más precisos y detallados de documentos extensos, facilitando la absorción y comprensión de grandes cantidades de información.

4. Nuevos Horizontes en Investigación y Educación

- En el ámbito académico, estos modelos pueden ser una herramienta invaluable para la investigación, proporcionando una forma eficiente de revisar y sintetizar literatura extensa. Igualmente, en educación, podrían asistir en el desarrollo de materiales de estudio personalizados a partir de una amplia gama de fuentes.

5. Potencial Futuro:

- Mirando hacia el futuro, los Infini-Transformers no solo se perfilan como una solución a los problemas actuales, sino como un catalizador para nuevas formas de interactuar con el texto en la era digital. Con su habilidad para entender y procesar grandes cantidades de información, estos modelos podrían desempeñar un papel clave en el avance de sistemas de IA más intuitivos, inteligentes y capaces de aprender de manera más efectiva.

A medida que continuamos explorando y expandiendo las capacidades de los Infini-Transformers, es emocionante imaginar las innumerables formas en que pueden moldear el futuro del procesamiento de lenguaje natural y más allá. Las posibilidades son tan amplias y profundas como los textos que estos modelos pueden ahora comprender.

Conclusión

Al concluir este viaje a través del innovador mundo de los Infini-Transformers, queda claro que estamos presenciando un cambio paradigmático en el procesamiento de lenguaje natural. El trabajo pionero del equipo de Google, como se detalla en su paper «Leave No Context Behind: Efficient Infinite Context Transformers with Infini-attention», no solo ha superado una barrera técnica, sino que también ha abierto un universo de posibilidades que anteriormente estaban fuera del alcance de la inteligencia artificial.

Los avances logrados con los Infini-Transformers no son sólo una mejora incremental; son un salto hacia adelante que redefine lo que es posible en el campo del PLN. Al abordar las limitaciones de memoria y procesamiento de textos largos, estos modelos no solo mejoran la eficiencia y la precisión, sino que también expanden la aplicabilidad de la IA en sectores como la ley, la educación, la investigación y más allá.

Mirando hacia el futuro, es emocionante considerar cómo los Infini-Transformers continuarán evolucionando y cómo su capacidad para procesar y entender textos extensos influenciará el desarrollo de nuevas herramientas y tecnologías. Estamos al borde de una nueva era de descubrimientos e innovaciones en IA, impulsada por la habilidad de comprender el lenguaje humano de una manera que antes era inimaginable.

En resumen, los Infini-Transformers no solo han resuelto un desafío técnico; han abierto una puerta a nuevas formas de explorar y entender nuestro mundo a través de la lente del lenguaje. Con cada texto largo que ahora se puede procesar y cada nuevo entendimiento que se puede obtener, los Infini-Transformers nos están llevando a un futuro donde las limitaciones del procesamiento de lenguaje son cosa del pasado.